ChatGPT、何が問題か

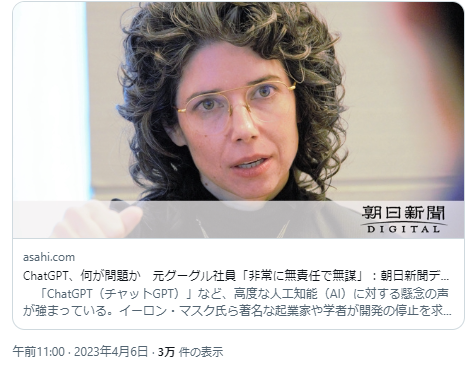

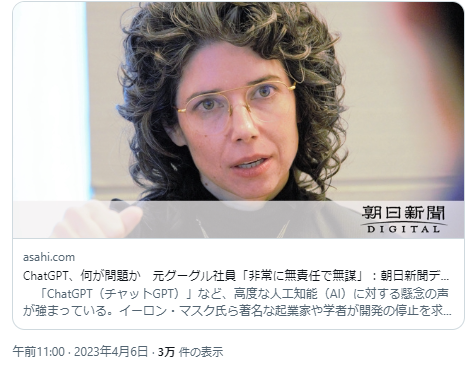

元グーグル社員「非常に無責任で無謀」

これは、技術的な飛躍というよりも、権限の集中の結果に生まれたもの

聞き手・渡辺淳基2023年4月6日 8時00分

「ChatGPT(チャットGPT)」など、高度な人工知能(AI)に対する懸念の声が強まっている。イーロン・マスク氏ら著名な起業家や学者が開発の停止を求めたり、プライバシーの面からイタリア政府が使用を一時的に禁止したりする動きも出てきた。何が問題の根底にあるのか。元グーグル社員でAIが社会に与える影響を研究し、警鐘を鳴らしてきたメレディス・ウィテカー元ニューヨーク大研究教授に聞いた。

監視によるデータ集中が生んだAI

――マイクロソフトが出資する米オープンAIの「チャットGPT」など、高度なAIの開発や、サービスの利用停止を求める動きが出てきています。何が問題なのでしょうか。

「倫理的な面でたくさんの懸念があります。一番問題なのは、世界で数えるほどの企業だけが、これらのAIを開発し、提供するリソースを持っているということです。中立的でもなければ、民主的でもない。究極的には、彼らの利益につながるようにつくられています」

「こうした企業は、膨大なデータとクラウド設備、そして(米グーグルの)Gメールや(米メタの)フェイスブックを通じてデータを抽出し続けるための巨大な消費者市場を持っています。いま話題のAIは、こうした資源と権限の集中の結果として生まれてきたもので、技術的な革新の成果ではありません。しかし、『魔法みたい』『人間より賢い』『いろんなことに使える』という誇大宣伝が、正確性も安全性もわからない実験的な技術を、正当化することに利用されています」

――なぜ、一握りの企業だけに集約されてしまったのでしょう。

「インターネットのビジネスモデルを早い時期に確立したのが、これらの会社だったからです。要するに、監視ビジネスモデルです。例えばGメールやフェイスブック。ここから集められた大量のデータがデータセンターに集約された。その膨大なリソースが、2010年代の初期にこういう大企業のものになったことが、いまのAIにつながっています。つまり、AIというのは監視モデルの延長線上にある。技術的な飛躍というよりも、権限の集中の結果であるといえます」

※全文はこちらから

https://www.asahi.com/articles/ASR444W17R42ULFA004.html